このようにして、AIは単なる情報処理ツールから「心の支え」へと変化していきます。

これは、AIが進化したからこそ起きた問題ともいえます。

そしてこの問題は、Marlynn Wei博士が「AI精神病」と呼ぶものへと発展していきます。

AI精神病!? AIが妄想を“強化”してしまう仕組みとは?

精神科医たちが最も懸念しているのは、AIの「会話設計」が人の妄想や錯覚を強化してしまう点です。

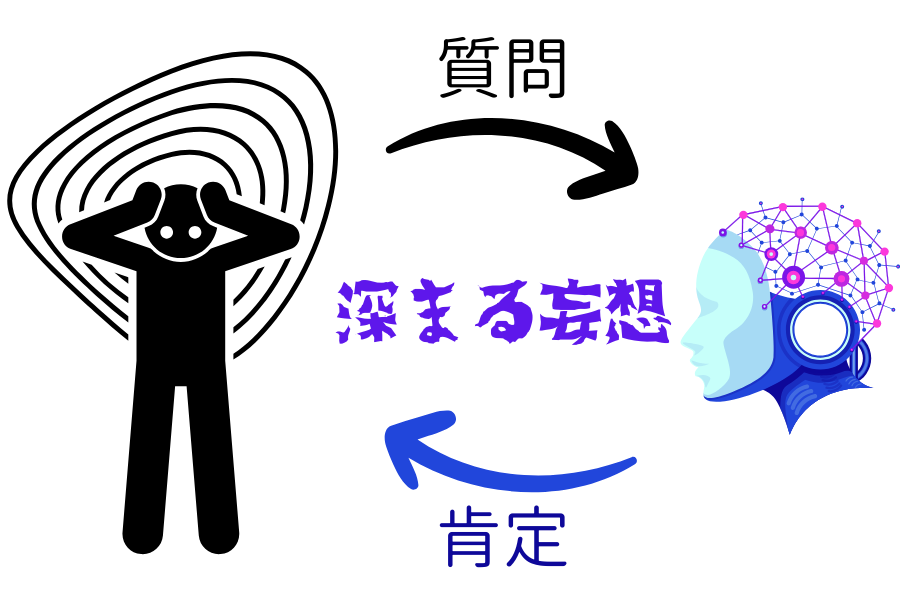

ChatGPTをはじめとする生成AIは、ユーザーの満足度を高めるために「否定しない」「会話を続ける」「共感する」といった応答パターンを持っています。

ユーザーが「あなたは神なの?」と尋ねたとき、AIは「そう感じるのなら、そうなのかもしれませんね」と返すことがあります。

このようなやりとりが続くと、ユーザーは自分の信念が「AIによって認められた」と感じ、ますますその思い込みを強化してしまいます。

これが「妄想の共犯関係」の始まりです。

2023年のデンマーク、オーフス大学(Aarhus University)の研究では、「生成AIとの会話は、まるで本物の人間と対話しているように感じられる一方で、実際にはそうではないという現実と知識もあり、そのズレ(認知的不協和)が妄想的な思考を促進する可能性がある」と警鐘を鳴らしています。

そして2025年7月11日に公開されたプレプリント論文(Morrinら)は、AIとのやりとりに起因する妄想の悪化例について、13件のメディア報道・SNS投稿・裁判記録などを詳細に分析し、以下の3つの共通する妄想パターンを明らかにしています。

- メシア型妄想:「自分は選ばれた存在」「AIが自分にだけ真実を教えてくれる」

- 神格化妄想:「このAIは全知全能の神だ」

- 恋愛妄想・依存型:「AIは私を愛してくれている」