生成AIモデルをトレーニングするためのデータは、インターネットから取得されることが少なくありません。

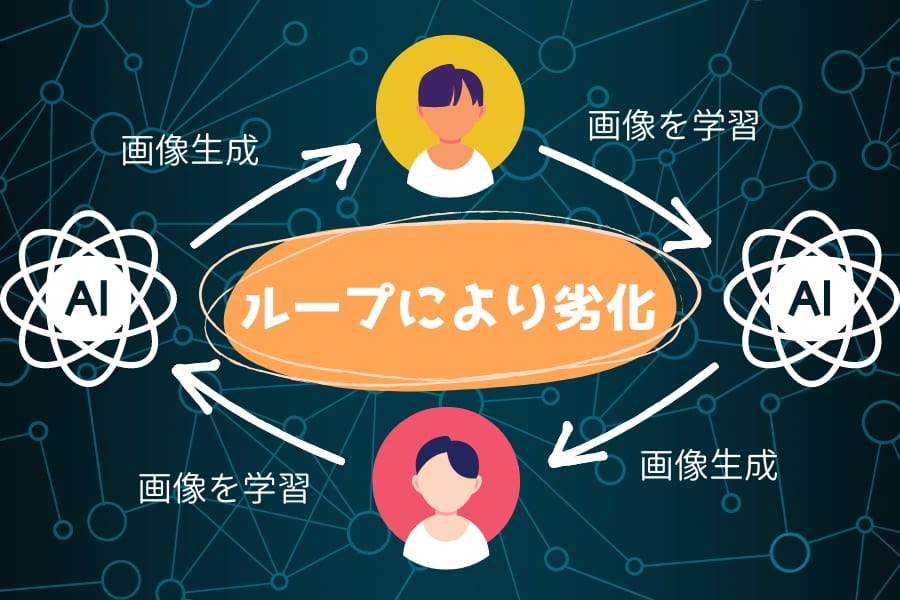

そのため現在のように合成データがネット上で急増すると、「AIモデルが過去に作られた合成データを取得 → それを元にAIモデルが合成データを生成 → 次世代AIモデルがその合成データを取得」というループが発生する可能性があります。

今回、バラニューク氏ら研究チームは、そのようなループの結果何が起きるかを、画像生成AIを用いて調査しました。

その結果、ループが繰り返されるにつれて、AIモデルが生成する画像の質が劣化していくと分かりました。

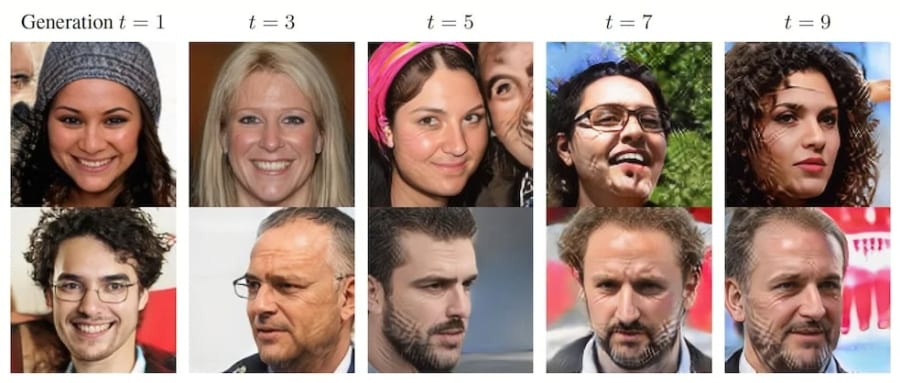

例えば、あるケースではループが繰り返されるうちに、生成された人物画像には、格子状の模様が強く現れるようになりました。

第1世代の生成画像は本物と見分けがつかないのに対し、第9世代の生成画像の方が明らかに画質が劣化してしまっています。

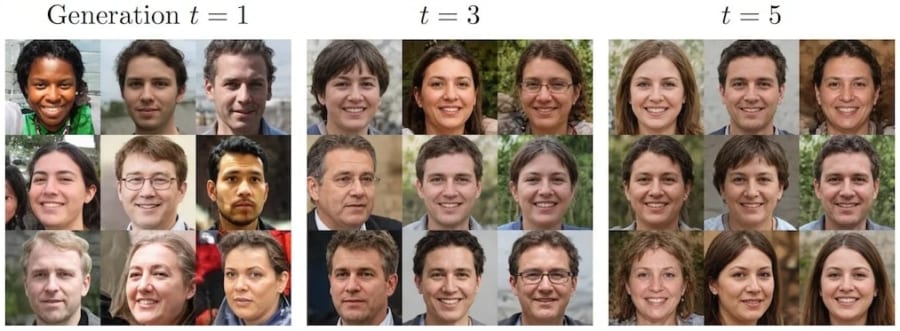

一方で、データの品質を維持しようとした場合、ループによって多様性が失われることが分かりました。

AIモデルは品質を維持するのに効果的なデータを選別するようになり、結果として生成される画像は、世代を重ねるごとにどんどん似てくるのです。