生成AIアプリケーション同士が人手を介さずに自律的にやりとりをする「IoA(Internet of Agents)」の登場と普及が、今後、私たちの生活にとって不可欠なものになるという近未来図を描くスタートアップがある。チューリッヒおよびサンフランシスコに拠点を置くLakeraだ。

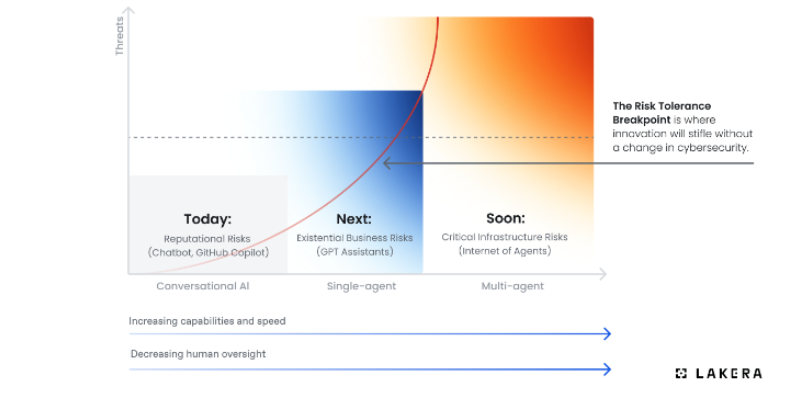

同社は一方で、IoAが、生成AIの中核であるLLM(Large Language Model)が持つセキュリティ脆弱性の問題を、より複雑にし、深刻化させると警告する。ネットワークの相互接続性により、障害の影響は前例のないレベルにまで拡大するとしている。

今年7月24日、LakeraはシリーズAラウンドで2,000万ドルの資金を調達したことを発表。この資金を活用して製品開発を加速し、シリコンバレーに拠点をもつ米国市場の開拓を拡大する計画だ。

IoAはサイバーセキュリティ脆弱性を大規模複雑化する

Image Credit: Lakera

従来は、経験豊富でコーディングができなければブラックハッカーになれなかった。しかしいまや、自然言語で読み書きさえできれば、“誰でもハッキングができる”のだ。たとえば受信ボックスにあるメールをAIで要約する機能は、同時に受信ボックスをハッキングする機能に容易に転用できるのである。

IoAの発展は、同時に相互接続され自動化されたシステムの規模拡大を意味する。攻撃者が、ある脆弱性を突いて突破できれば、攻撃者はネットワークをたどって、あらゆる場所での大規模な攻撃が可能になる。あるいはLLMを侵食すれば、そのLLMを利用しているアプリケーションに影響が拡大する可能性がある。同社は、「IoAの動作速度を考えれば、ネットワーク内で侵害されたノードは、非常に急速に大規模に伝播する可能性がある」としている。