生成AIが世界を変革する現代において、その効用を最大限に活用するためには、生成AI利用におけるデータプライバシーとセキュリティ保護の問題を解決する必要がある。

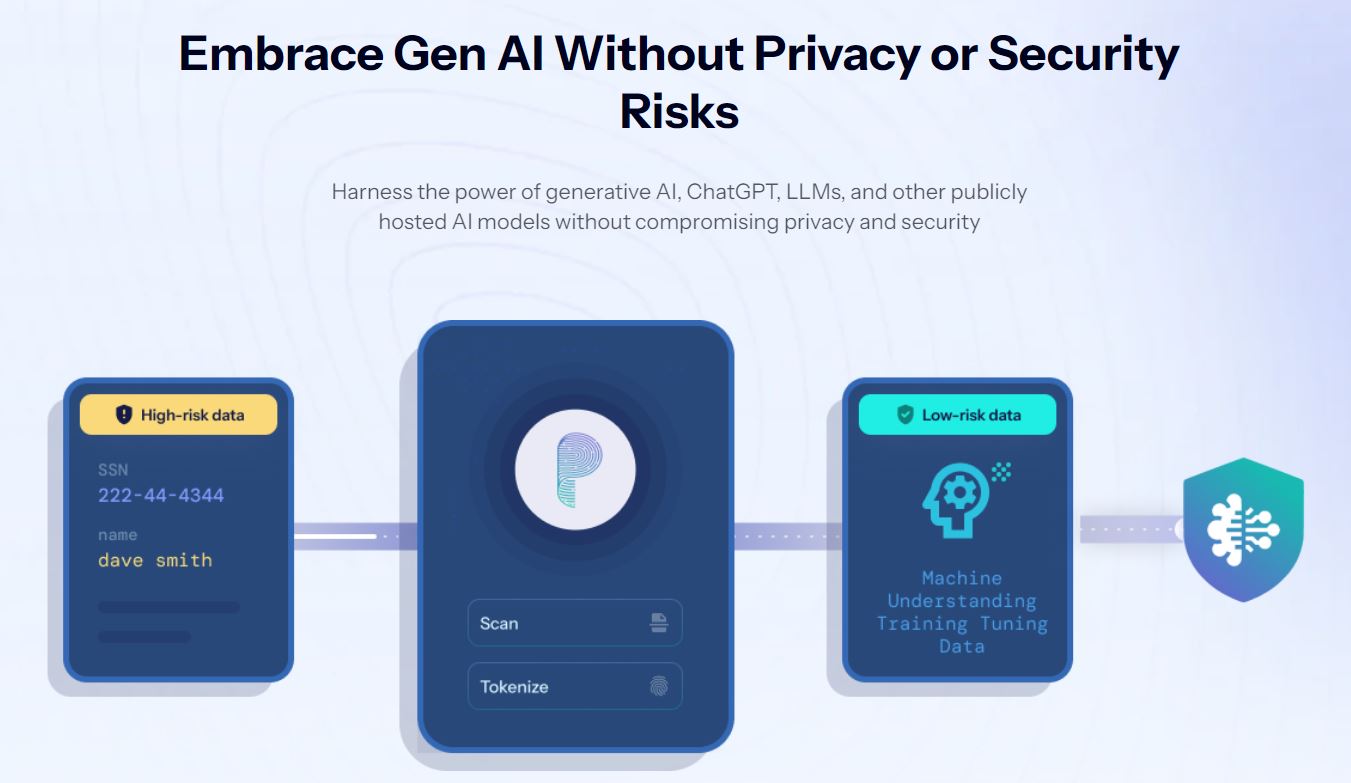

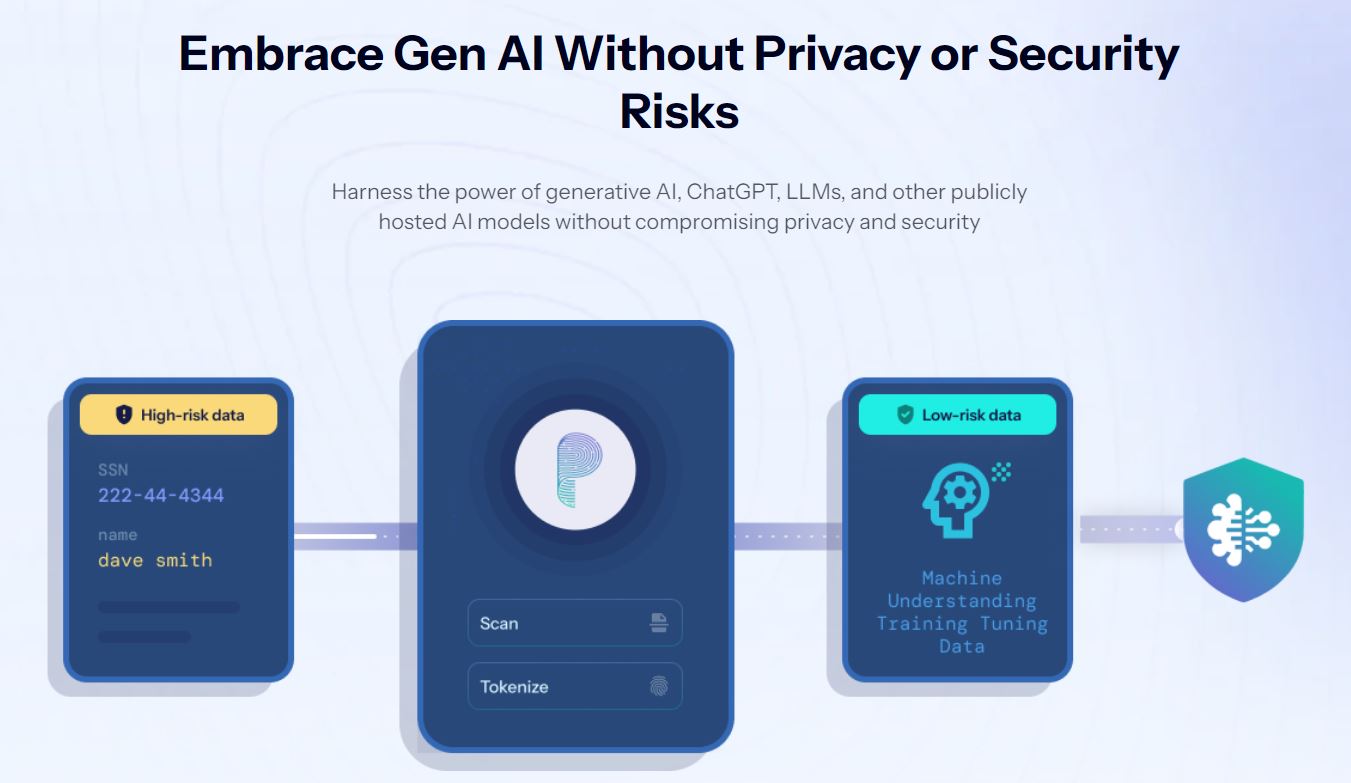

この問題解決を使命に掲げる米国スタートアップProtectoは、生成AIを安全に利用できるソリューションを開発。生成AIのトレーニング、チューニングから利用までのライフサイクル全体でデータを保護するプラットフォームだ。

Image Credits:Protecto

カルフォルニア州サンノゼ、通称シリコンバレーに拠点を置く同社は、2023年11月にシードラウンドで400万ドルの資金調達を行った。2021年のGoogleおよびMicrosoft幹部からのエンジェル投資と合わせると、これまでの資金調達総額は500万ドルとなる。新たに調達した資金を使って、トップエンジニアリング人材を採用すると共に、市場戦略の拡大に注力する計画だ。

生成AI活用に不安を抱える企業、漏洩事件も発生

専門スキルがない人でもデータ分析が可能になる生成AI。その分析対象と複雑さ、扱うデータ量は日々拡大し続けている。探索対象は顧客データや業績データなどの構造化データに限らない。チャット履歴や文字起こしした営業電話の記録、SNSや自社コミュニティのディスカッションなど、非構造化データにまで広がりつつある。

こうした広範な非構造化データは非常に複雑なため、本質的に高いセキュリティリスクを伴う。さらに、個人情報や機密情報を含むため、不正アクセスやデータ漏洩、プライバシー侵害のリスクもあるのだ。

企業はChatGPTなどの生成AI利用の果実を享受する一方で、データプライバシーやセキュリティリスクなどの懸念を抱えている。事実、2023年4月に起きたサムソンのデータ漏洩事件は、従業員が悪意なく機密情報をChatGPTに入力したことから発生したケースだ。

セキュリティ懸念と規制が生成AI採用に影響する可能性も

漏洩事件の結果、ChatGPTの利用禁止やガイドライン策定などの対応が取られた。しかし、ガイドラインや従業員教育だけでは、膨大な潜在リスクの管理は難しい。

2024年3月13日にEUが採択した人工知能アクト(AI Act)は、5月21日に最終承認を受けたばかり。AIに関する世界初の包括的な法的枠組みとされている。

AI Actはデータの質や透明性、人間による監視および説明責任に関してEU全体で規制を行うもの。厳しい要件と顕著な域外効果に加え、最大3500万ユーロまたは年間世界収益の7%(いずれか高い方)の罰金により、EUで事業を行う多くの企業に多大な影響を与えるだろう。

セキュリティと漏洩事故への懸念から、生成AIの採用が遅れる可能性があるのだ。Protecoの使命は、これら問題に対処するソリューションを提供することにある。