AIを活用した不正検知サービスやサイバーセキュリティーサービスを開発・提供している株式会社ChillStack。

同社の代表を務めるのは、国際セキュリティーコンテストでの優勝経験もある伊東道明さんです。

U-NOTE編集部は、伊東さんに、AIを使ったサイバー犯罪の現状や今後、個人や企業としてできる対策は何かを聞きました(全3回中1回)。

AIで守り、AIを守る企業・ChillStackとは?

―――まず、御社の業務内容をお伺いしてもよろしいでしょうか?

弊社は、“AIセキュリティー”を柱とし、技術を使っていろいろなソリューションを作って、お客様に提供する事業を行っている会社です。

AIセキュリティーとひと言で言っても広いんですが、大きく2つに分けられます。

AIを活用して不正や異常の検知をするようなセキュリティーシステムをつくっていく「AI for Security」が1つ。

もう1つとして、そのAIを安全に使えるよう(攻撃から)守る「Security for AI」です。

ChillStackで提供しているサービスの1つ、「Stena Expense」

―――AIをサイバー攻撃から守るための知識やノウハウを提供するeラーニング(インターネットを通じて行う学習や研修)事業も行っていらっしゃいますね。

はい。三井物産セキュアディレクション様と共同で提供しています。eラーニングに加えて、現地でのハンズオントレーニング(実践を交えた研修)も合わせて提供しています。

―――今、世界において生成AIはかなり発展してきています。

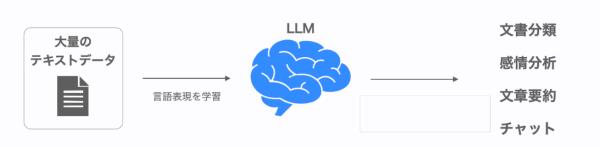

皆さんご存知の通り、OpenAI社のChatGPTをはじめとして、Google社のBardなど、各社がLLM(大規模言語モデル=大量のテキストデータを処理し、予測や応答を生成する能力を持つAIの一種)を活用した生成AIサービスを開発・提供しています。

直近だとChatGPTを使った「GPTs」というツールを作るなど、(生成AIを)利活用する方向にどんどん発展してきていて、業界全体がすごく盛り上がっていると感じます。

日本も今ようやくChatGPTを使う基盤を整えて、業務にも利用し始めている会社も増えてきた状況だと思います。

―――毎日ネットで生成AIを活用したサービスがたくさん発表されていて、ちょっと追い切れない部分もあるなと思います(笑)。

本当におっしゃる通り、追い切れないところがあって(笑)。

ChatGPTもその1つなんですけど、AIの開発や利活用がしやすい環境が整ってきているんです。それもあいまってですね。

―――環境が整っている分、悪い人も使いやすいってことですね。

おっしゃる通りです。たとえば、「WormGPT」と呼ばれるものもあります。

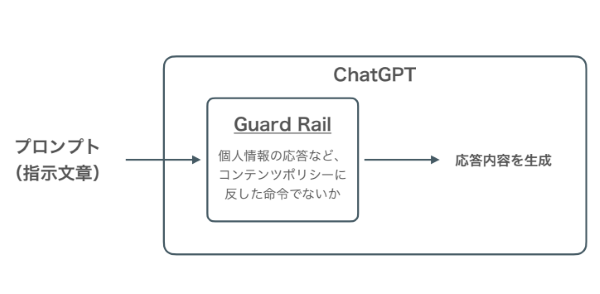

ChatGPTには、悪いことができないよう、コンテンツポリシーに反することを応答しないようにする「Guard Rail」という機能があるんですが、WormGPTにはGuard Railのような制御機能が存在しないため、簡単に悪用することができるんです。