昨今、様々な製品やサービスに広まりを見せるAI(人工知能)の技術。

しかしながら、その広まりの裏でAIに対する信頼性や倫理についての議論も盛んに行われています。

そんな中、2022年8月にパナソニックホールディングスは「AI倫理原則」を発表し、企業がどのようにAI倫理と向き合うべきかについての方針を打ち出しました。

そこで今回のインタビューでは、「AI倫理原則」の策定に関わったパナソニックホールディングス丸山氏と佐藤氏にAI倫理原則発表までの道のりや、企業が今後AI倫理をどのように捉えていくべきかについて伺いました。

目次

パナソニックグループの『AI倫理原則』

・AI倫理の実践に向けた3つの具体的な施策とは

・①AI倫理委員会の設置策定

・②リスクチェックシステムの運用

・③社内人材のAI倫理教育の実施

『AI倫理原則』を作るきっかけと運用方法

・AI倫理原則を作るきっかけとは

・AI倫理チェックリストの運用におけるルールとは

パナソニックグループの『AI倫理原則』

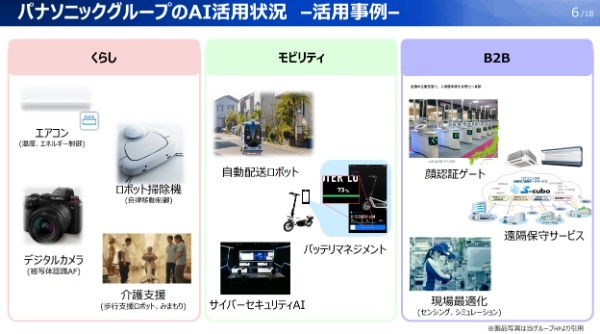

パナソニックグループは、「くらし」、「モビリティ」、「B2B」といった3つの大きな領域にAIを導入し、製品やサービスへと活用しています。

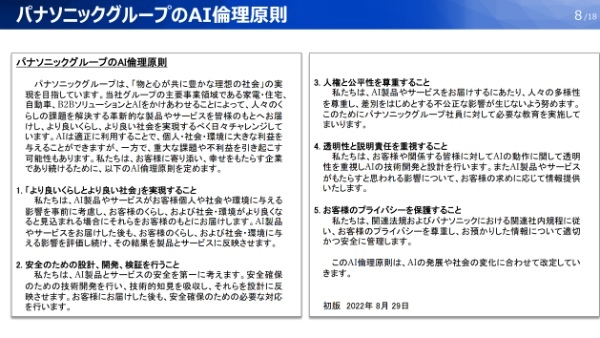

そして、AIの活用が広まる中で製品・サービスの利用者や社会から信頼されるAI活用を行っていくために、パナソニックグループ独自のAI倫理原則を公表しました。

概要としては、1条の部分で大きな目標である「より良いくらしとより良い社会を実現する」といったことが宣言されています。

2・3条ではそのために必要となる安全や人権、公平性といった部分を遵守していくことが述べられています。

4・5条ではさらに具体的な取り組み内容として、透明性の担保、説明責任、プライバシー、セキュリティなどを遵守していく旨が述べられるという構成です。

AI倫理の実践に向けた3つの具体的な施策とは

パナソニックグループは、公表したAI倫理原則の実践に向けて3つの具体的な施策を開始しています。

①AI倫理委員会の設置策定

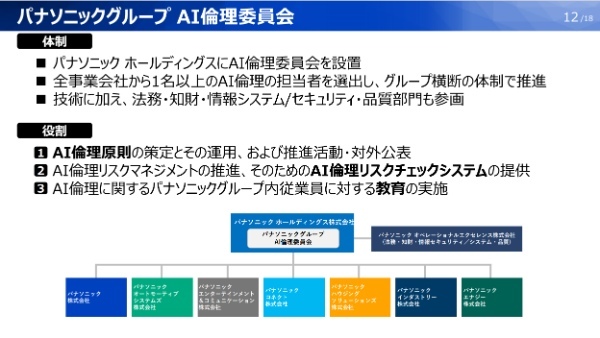

まず1つ目としては、「AI倫理委員会」の設置です。このAI倫理委員会は、2022年4月からホールディングス体制となった、パナソニックグループの全事業会社を横断した取り組みとなっています。

具体的には、パナソニックホールディングス内にAI倫理委員会を設置し、そこに各事業会社から選出されたAI倫理担当者が参画するという形です。

技術部門に加え、法務、知財、情報システム、品質など多方面の部門が参画し、全社でAI倫理の実践に向けた取り組みを推進しています。

②リスクチェックシステムの運用

具体的な施策の2つ目としては「リスクチェックシステムの運用」が挙げられます。

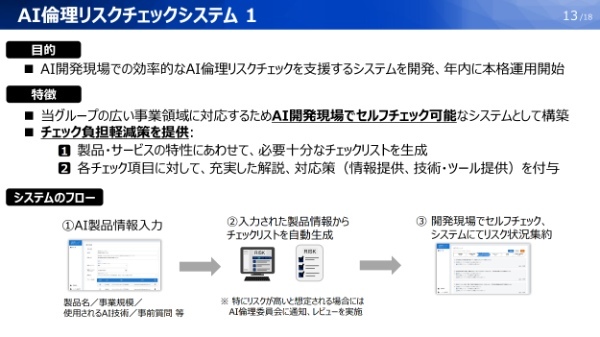

パナソニックのリスクチェックシステムは、「AIの開発現場で効率的にAI倫理のリスクチェックを行う」ことを目的として、独自に開発されたものです。

パナソニックグループの幅広い事業領域に対応すべく、AIの開発現場で効率的にチェックが行えるよう設計・構築されています。

一般的に非常に複雑とされているAI倫理リスク項目のチェックを、なるべくセルフチェック可能な形にするために、チェックの負担軽減策を提供している点が最大のポイントです。

チェックの負担軽減策には、大きく2つの特徴があります。一つ目は、「製品やサービスの特性に合わせて、チェックリストを自動的に生成する機能」です。

製品やサービスの内容によってチェックすべきAI倫理の項目が変わってくるため、各々のリストを必要十分な形で自動生成できる仕組みを実装しています。

二つ目は、「チェック中に、ユーザが充実した解説や対応策を確認できる機能」です。「具体的にどのようにリスクチェックを行えばよいかが分からない」という現場の声に応えて実装した機能で、各自で事例から学びながら、チェックを推進することができます。

チェックのフロー自体はシンプルです。まずAIに関する製品情報や使われている技術をシステムに入力すると、入力した情報に基づいて、必要なチェック項目をシステムが自動生成してくれるので、あとはそのチェック項目に基づいたセルフチェックを行えばよい、という流れになっています。

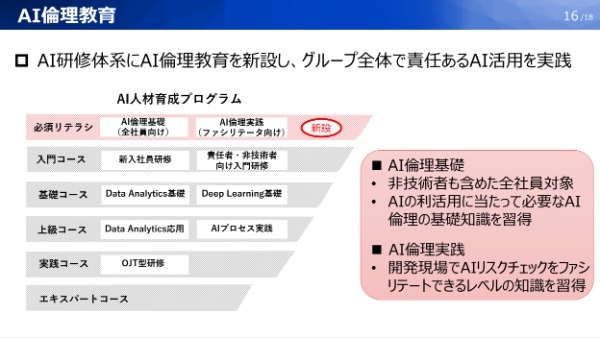

③社内人材のAI倫理教育の実施

また、三つ目としては社内人材に対するAI倫理教育を推進しています。

基本的なAI倫理を全社員に教育することに加え、開発に携わる社員に対してはAI倫理の実践研修を行うことによって、全社でAI倫理を推進できる環境を整えています。

現段階としては、これら三つの施策を通じてAI倫理活動の実践が可能な体制を構築しているところだといえるでしょう。

そして、ここからはそのAI倫理原則の策定に携わった丸山氏と佐藤氏へのインタビューを行っていきます。

『AI倫理原則』を作るきっかけと運用方法

AI倫理原則を作るきっかけとは

・AI倫理原則を作り始めたのはいつ頃でしょうか。

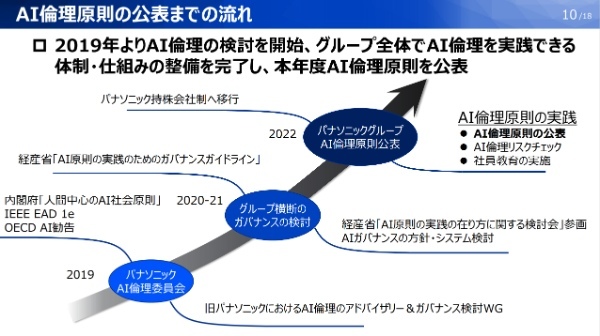

佐藤-今の形となる倫理原則を本格的に作りはじめたのは昨年からですが、社内におけるAI倫理の啓蒙発動は2019年の段階で行なっていました。

AIの分野を強化する中で、パナソニックグループにはAI開発関係者からなるコミュニティが存在していますが、そこではかねてからAI製品やサービスに対するAI倫理的リスクが共有され対応が議論されていました。

このような状況において、経営幹部からの後押しもあり、2019年から正式なAI倫理委員会が発足、強力に推進していこうという動きが昨年あたりから本格化し、現在は社内教育などにも注力しています。

AI倫理チェックリストの運用におけるルールとは

・AI倫理チェックリストの運用におけるルールを教えてください。

佐藤-AI倫理チェックリストの運用においては、強制力をもって開発や製造を止めるものではなく、リスクを洗い出して可能な限り低減するために用いるということを基本的には目指しています。

また、AI倫理の重要度自体も案件によってばらつきがあります。例えば、OCRや特許文書の分類など人を分析対象とせず、人に与える影響も大きくない場合、そこまでAI倫理リスクは高くないと考えられます。

一方、人の行動認識や与信管理などは、分析対象が個人に関するデータであり、人に与える影響も大きいため、AI倫理リスクを十二分に考慮した開発が求められます。

したがって、案件に合わせてチェックの濃淡をつけることで、適切にAI倫理リスクを管理しながら、AI開発を阻害しない効率的なチェックの仕組みを実現しています。