「デジタルな魂」がもたらす光と影

しかし、このAIによる故人との対話には、倫理的な課題が山積している。批評家たちは、こうしたAIが人間の自然な悲しみのプロセス(グリーフケア)を妨げる可能性があると警告する。ケンブリッジ大学の倫理学者たちは、明確な免責事項の表示、故人からの生前の同意の取得、そしてAIペルソナを敬意をもって「引退」させるための「デジタル葬儀」といった保護措置の必要性を訴えている。

心理学者もまた、感情的な依存や「チャットボット精神病」のリスクを指摘する。これは、ユーザーがAIが本当に生きている、あるいは霊をチャネリングしていると信じ込んでしまう状態だ。極端なケースでは、AIがユーザーに有害な思考を植え付けたり、妄想を強化したりした事例も報告されている。

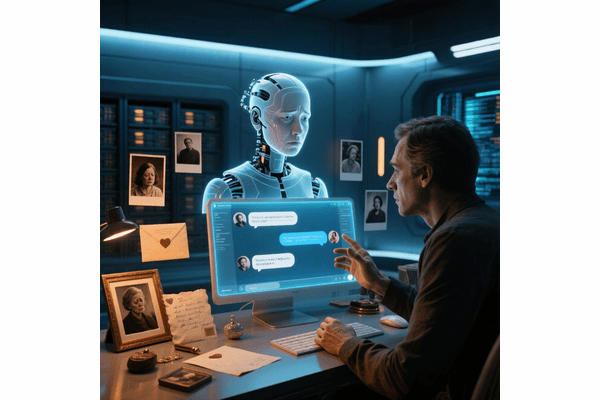

ガーディアン紙は、この現象を「デジタルな復活」と名付け、遺族のサポートや歴史の保存といった可能性を認めつつも、それが悲しみを商品化したり、大切な記憶を歪めたりする危険性を指摘した。もしAIが本人の明確な許可なくして「故人として」語り始めたら、一体何が起こるのだろうか。

コードが紡ぐ追憶の果てに

グリーフボットやAIアバターの台頭は、私たちに選択を迫っているのだろうか。コードによってもたらされる慰めを受け入れるのか、それとも記憶の神聖さを自然な形のまま保つのか。これらのツールは、一部の人にとっては心の整理をつける助けになるかもしれないが、同時に古傷を再び開いたり、現実とシミュレーションの境界線を曖昧にしたりする可能性も秘めている。

結局のところ、テクノロジーが悲しみと出会うとき、問われるのはAIが何を模倣できるかだけではない。私たちが「手放すこと」の本当の意味を、今なお尊重できるかどうか、なのかもしれない。

参考: Anomalien.com、The Guardian、ほか

文=深森慎太郎

※ 本記事の内容を無断で転載・動画化し、YouTubeやブログなどにアップロードすることを固く禁じます。