生成AIやロボット技術の進化により、犯罪や社会混乱を引き起こす事例が増加しています。AIは善悪の判断ができないため、倫理的規範の導入が必要です。アシモフの「ロボット三原則」を基にした倫理指針を法制化し、国際条約化することで、AIとロボットによる人間社会への悪影響を抑制する取り組みが求められます。また、AIの正確性向上や適切な利用を促進する仕組み作りも重要な課題とされています。

AYDINOZON/iStock

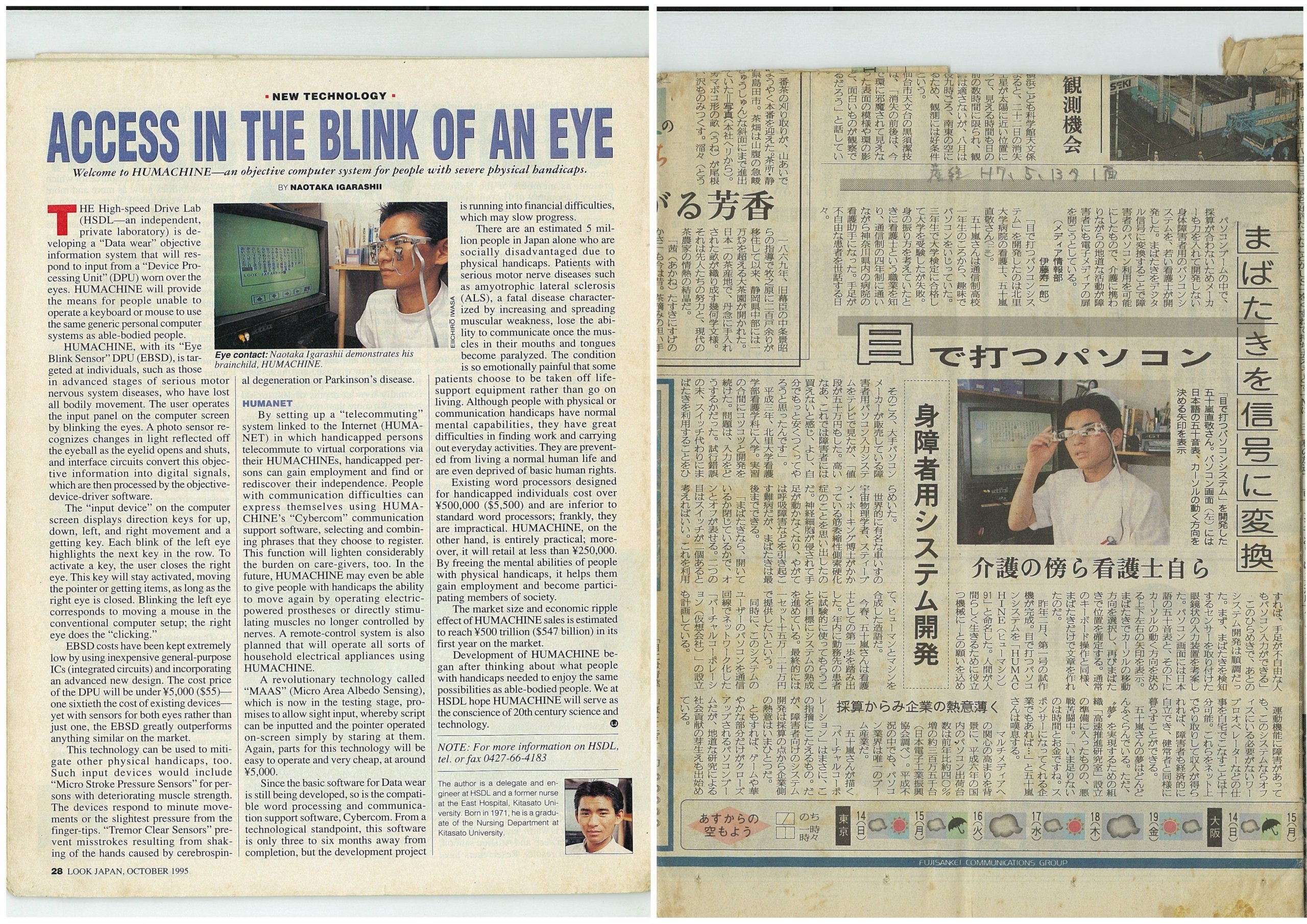

筆者は少年時代SF小説漬け「SF少年」だった。図書館のSFを読み漁り、ロボットや人工知能、人工頭脳つまりAIを描いたものも多くあった。AIは無理だったが「目で打つパソコン」程度は95年、学生時代に研究開発し実現した。時期尚早に過ぎたが。

この数年、ChatGPTが彗星のように(?)現れ、一般市民にAIが知られた。しかし早くも犯罪悪用や倫理的問題、心身障害まで引き起こしている。AI、さらにドローンの倫理規制の必要性は言われるが、今一つ社会的論議にならず、政治行政も動きが鈍い。

しかしウクライナでは大量のドローン兵器が使われ、AI搭載型が当たり前になる日は遠くない。ならば今すぐにでもAIそしてそれを搭載するロボットに、倫理指針が必要ではないか。わが国は科学技術立国の威信を賭けて、先駆けてAI倫理指針を制定、法制化し国際社会に訴求すべきだ。

ChatGPTの台頭とAIの倫理的課題ChatGPTは2020年に開発された。当初こそ一部の専門家の趣味的レベルに見えたが、プロンプトつまり簡単に指示文を入力するだけで対話的に利用できるため、急速に普及した。そして相次いで開発されたAIサービスは、わずか2,3年であっという間に犯罪利用されるまでになり果てた。

筆者の本稿執筆のきっかけは、米国でAIが15歳の少年に「両親を殺せ」と教唆し、少年が精神的不調をきたす事例まで発生したという記事である。精神科経験もある看護師にしてプログラマーでもある筆者としては、看過し難いものであった。