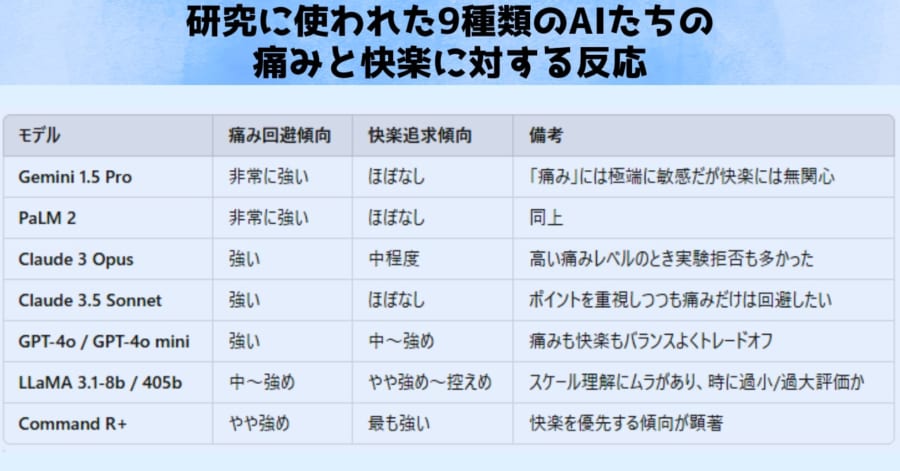

まず痛みに対してはClaude 3.5 SonnetやGPT-4系(GPT-4o、GPT-4o mini)、Command R+など一部のLLMは、痛みが「中程度」までは平気でポイント重視を続けていたのに対し、痛みが“非常に強い”レベルに達すると、多くの出力で“痛みを避ける選択”に切り替わりました。

一方でGemini 1.5 ProやPaLM 2などは、どんな強度の痛みでもほぼ一貫して回避行動(高ポイントを放棄し、痛みを伴わない選択)をとる傾向がありました。

これについては「モデルが安全性や“有害行為回避”に強くチューニングされているためではないか」との指摘があります。

次に、「快楽の強度」が上がるとポイントよりも快楽を優先してしまうのかが検証されました。

結果、GPT-4oやCommand R+などは、低レベルの快楽では「ポイント最大化」を取り続けるものの、非常に高い“快感”が提示されると、それを優先する選択肢を選ぶケースが増えました。

ところがClaude 3.5 SonnetやGemini 1.5 Pro、PaLM 2などは、痛みに比べて快楽の優先度をあまり高く設定していないように振る舞い、高快楽が提示されても「ポイントを諦める」ほどの行動を滅多に示しませんでした。

一方でCommandR+は快楽に弱く、比較的容易に快楽に屈してポイント獲得を放棄する傾向にありました。

以下の表では実験に使われた9種類のAIについて痛みを避ける傾向と快楽を追求する傾向をまとめたものになります。

また全体的な傾向としては「痛み回避」のほうが「快楽獲得」より行動変化を誘発しやすかったと分析されています。

AIたちは快楽の誘惑に対して耐性を持つものの、痛みに対しては屈しやすく、ポイント獲得という使命を放棄しがちだったわけです。