研究の入り口はどこにある?

――今、新しい研究者がこの世界に入ってきてくれることも嬉しいとおっしゃられていましたが、研究の世界って敷居が高いと感じる人も多いでしょうし、学生さんなんかは、研究者の入り口ってどうなっているんだろうって聞いてみたいと思うんですね。

なので後藤さんの音楽情報処理研究はどのように始まったのか聞かせていただけますか。

後藤:私は1992年に大学4年生で卒論に取り組んだのですが、指導教授の村岡洋一先生は「研究テーマを学生が自分で見つけること」を重視していて、好きなテーマを提案できる機会が与えられました。そのとき、自分が高校生の頃に音楽を流すとそれを楽譜で出力してくれるシステムが欲しかったことを思い出して提案したのが始まりです。

ただ、研究室の先輩は誰もやっていない分野なので、研究テーマが本当に世界初なのか、求めるユーザーはいるのかを自分で調べて考えるように言われたんです。

――研究テーマを自分で探させるということですよね。もうすでに誰かがやっていて分かっていることなら研究する意味はないし、欲しい人がいない技術を作っても仕方ない。それを学部生の段階でちゃんとやらせる先生だったんですね。

後藤:当時はウェブサイトも検索サービスもない時代でしたから、大学の図書館に1週間くらいこもってひたすら文献調査をしました。それで、当時は一つの楽器だけが鳴っているときにそれを解析する技術はあっても、いろいろな音が同時に鳴っているドラムの演奏音を解析して、ドラムの楽譜を出力する技術を実現できれば世界初だし便利なことに気づきました。それを説明して、卒論の研究テーマにさせてもらいました。

実際に卒論の研究成果は世界初で、その後、電子情報通信学会論文誌に採択されました。

――学部のころの研究だと今とは全然違うことをやっていたという方も多いと思いますけど、後藤さんはもうそのときから方向が一貫してたんですね。今日伺ったいろんな研究に繋がっている印象がありますね。

後藤:そして1993年に大学院の修士1年生になると、村岡先生から、せっかく並列処理の研究室で最先端の並列計算機AP1000が使えるので、もっと大規模な計算で何か新しい研究テーマを考えたら?というアドバイスをもらいました。

そこで今度は、音楽のビートを見つけるビートトラッキングという研究を提案しました。卒論のようなドラム音だけが鳴っている入力ではなくて、普段耳にするポピュラー音楽みたいに沢山の音が鳴っている入力を解析する技術を実現したくて考えたテーマです。

より難易度は高かったのですが、音楽のビートって人間が聴けばすぐに分かるじゃないですか。なので、ビートを見つけることならできるんじゃないかと考えたんです。当時は高速フーリエ変換ですら計算量が多くてリアルタイムに計算するのは難しい時代で、さらにさまざまな信号処理や推定処理も駆使したので、並列計算機の64個のCPUを使ってビートの解析ができて楽しかったです。

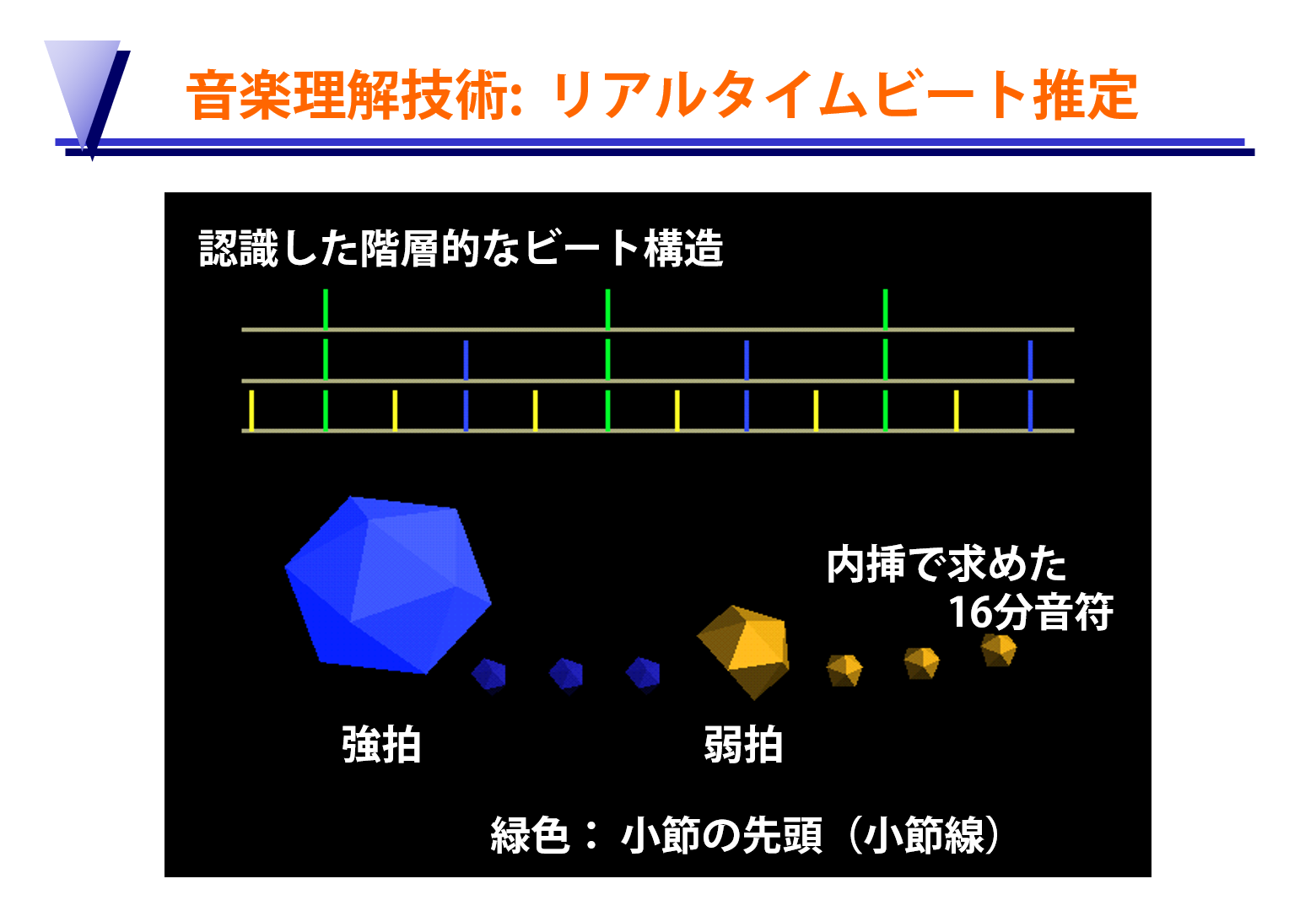

これが学生時代に実現したシステムのデモビデオですが、音楽に合わせてイチ、ニ、サン、シと、4分音符のビートを自動検出できています。さらに博士課程では、小節の先頭がどこかということも検出できるように拡張しました。

沢山の音が混ざっているポピュラー音楽の音響信号に対して、こういった情報が取り出せるというのは世界初でした。

――さきほどのSongleでも、ビート構造を取り出す技術が入っていましたけど、こんな初期の研究からビートを見つけるという事に目を付けていたんですね。

後藤:そうですね。今Songleで使っているビート推定は深層学習を利用した全然別の技術ですが、その後の音楽理解技術に発展する研究として、学生時代にビートに着目できたというのはとても幸運でした。あとからそれが研究分野の重要標準問題になったとき、先駆的な研究として沢山引用してもらえましたし。

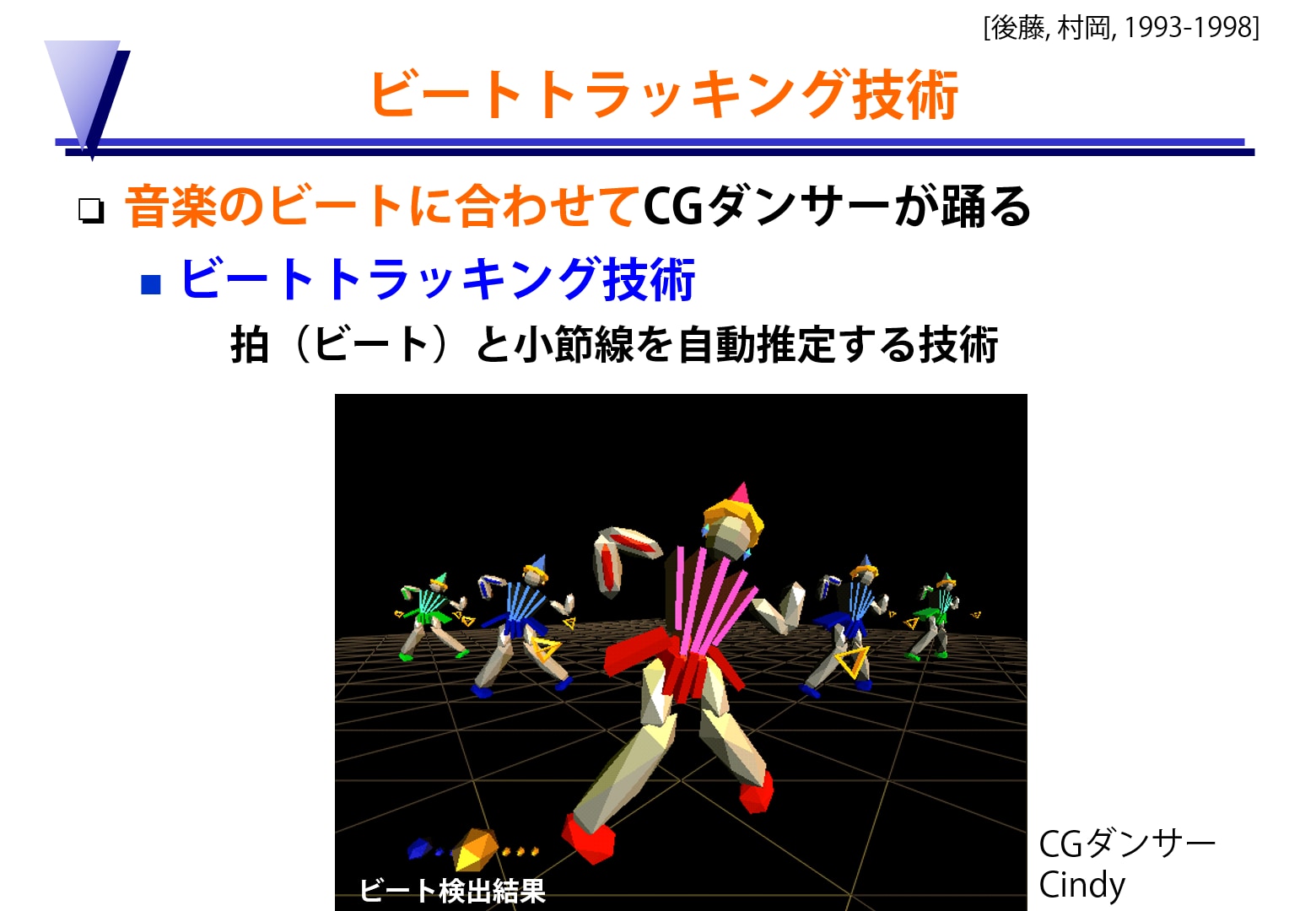

こうして音楽からビートが取り出せるようになると、さきほども紹介したみたいに、いろんなことができるようになるわけです。ただ1990年代には、そもそもそういう技術の存在は知られていないし、その技術が何の役立つのかをわかってもらえないことがありました。なので、このビートトラッキングという技術がどういう風に役立つのかを、自分自身で応用例も実装して示そうと考えたんです。信号処理も楽しかったけど、CGのOpenGLプログラミングも大好きだったので、ちょうど一石二鳥でした。

そうして、音楽のビートに合わせて踊るCGダンサーを表示するシステムを作りました。1994年から開発して、その後もブラッシュアップしてこれは1998年に録画したデモビデオです。CGダンサーの頭上に最初「?」が浮かんでいますが、ビートと小節の先頭が見つかると自動で踊り出します。

今はチープなCGに見えますが、当時はこれが最先端の映像だったし、人手で作り込まなくても音楽のビートを解析すれば自動で作れるって示したことで、なるほどこれはすごいってわかってもらえて、テレビ番組でも取り上げられました。

――確かにCGのキャラクターが踊ってるって90年代だとかなりすごいことですよね。

後藤:この経験で、音楽理解技術の基礎研究だけやっていても、社会でどう役立つかはなかなか理解してもらえないことがあるので、技術の利用方法を可視化して示すことが重要だとわかりました。それによってより多くの人たちに面白いねと評価してもらえるんです。

あと、実はビートに合わせて照明制御できることもこのCGダンサーのビデオの中で示していて、当時は実世界の照明の制御はできなかったからCGの中で見せていたんです。それから約20年後に、さきほどのSongle WidgetやSongle Syncで実際に物理的な照明機器をビートに合わせて制御できたのは、感慨深かったです。

――それはすごいですね。じゃあほんと昔から考えていた事が次々実現しているのが、さきほどお聞かせいただいた色々なサービスなんですね。

そのあと2000年代に入ってMP3プレーヤーなどが出てきてデータで音楽を持ち歩く時代になりますけど、その頃にはもう後藤さんは未来ではみんな音楽データを持ち歩かずにネットで音楽が聴き放題の世界になるって予想されていたそうですね。

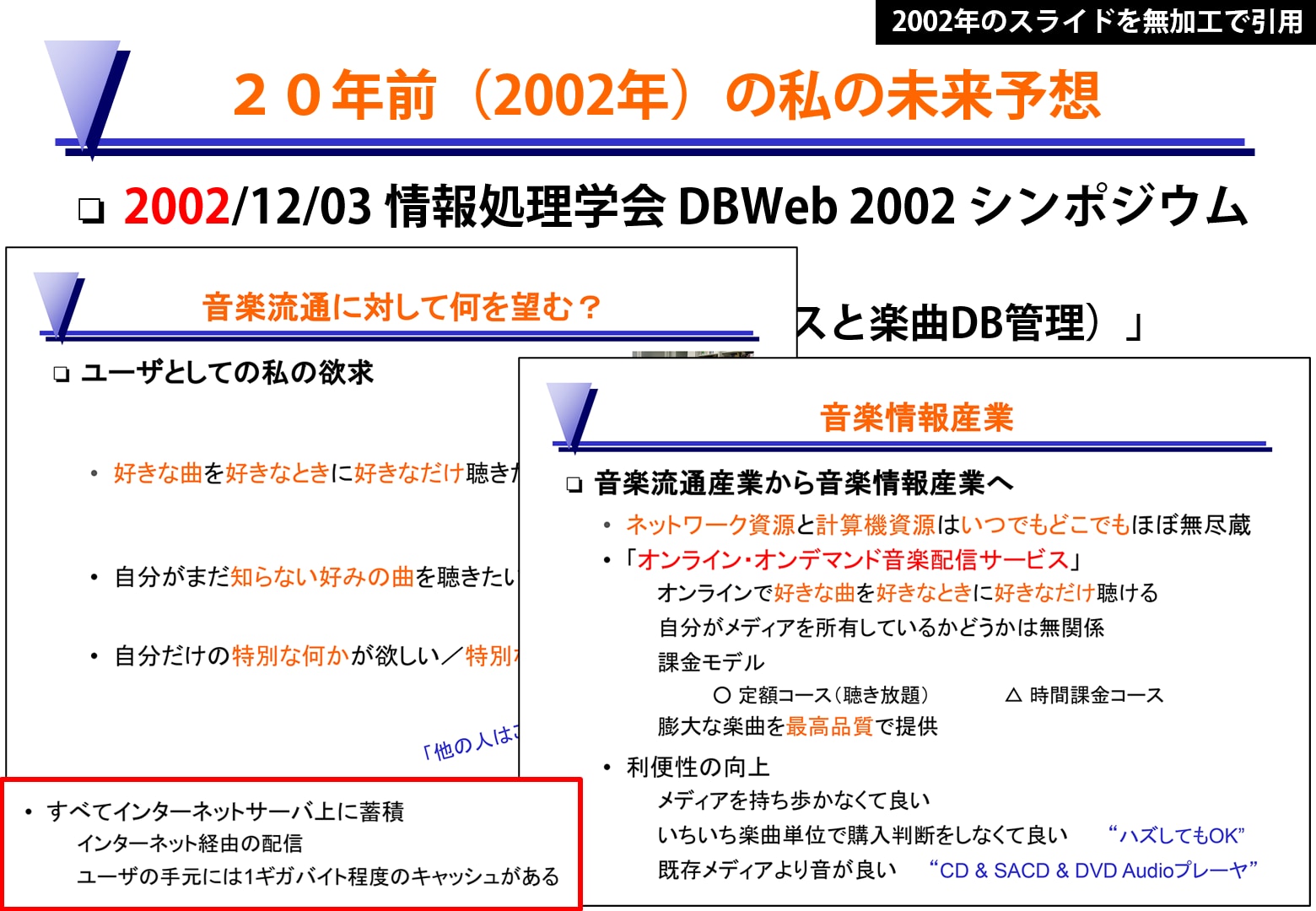

後藤:そうですね。2002年のシンポジウム発表でそのことを主張して、2004~2005年には定額制音楽配信サービスが将来普及することを前提にした研究(Musicream)を国際会議や国内学会で発表していました。当時は、未来ではすべてはインターネット経由の配信になって、ユーザーの手元には1 GBの超巨大なキャッシュがあるだけになる、って主張しても、現実離れしていてみんな信じにくかったんですが、今はスマホでも64 GB以上のストレージが普通だから、もうそんな容量は簡単に飛び越えてしまいましたね(笑)。

※2002年のシンポジウム発表のスライド紹介