普段メガネをかけている人は、朝起きた時に手探りでメガネを探してつかみ、耳にかけることがあるでしょう。

また部屋が暗くして映画を見ているときなども、テレビのリモコンをつかんで操作することは簡単にできるはずです。

このように、人間は視覚に頼らずとも、触覚だけで器用に物体を扱うことができます。

これはロボットが持たないハイレベルな技術です。

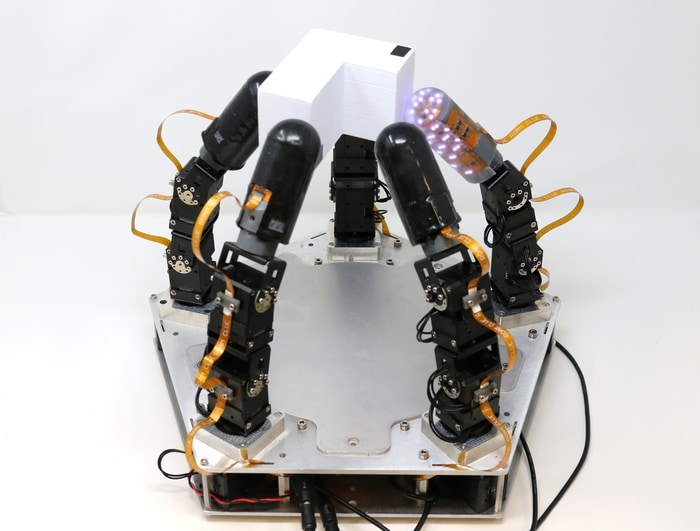

アメリカ・コロンビア大学(Columbia University)コンピュータサイエンス学部に所属するガガン・カンデイト氏ら研究チームは、視覚に頼らず指だけで物体を器用に操るロボットハンドを開発しました。

このロボットハンドは暗闇の中、5本の指だけで物体を空中で保持し、動かせます。

研究の詳細は、2023年3月11日付でプレプリントサーバ『arXiv』で発表されており、2023年7月に開かれるロボット工学の国際会議「Robotics: Science and Systems 2023」で扱われる予定です。

高度なAIに負けない「器用なロボットアーム」が求められる

ChatGPTがそうであるように、近年のAI技術は大きな進歩を見せています。

人間が指示するだけでプログラムコードさえも書けてしまうため、様々な指示に即座に対応する自律型ロボットの誕生もそう遠くはないのです。

Microsoft研究チームがChatGPTを使用し「言葉で指示してロボット制御」に成功!

例えば、人間が「サンドイッチを作って」とお願いすると、ロボット内のAIがサンドイッチの作り方を調査。手順ごとに体を動かすプログラムコードを書き、それを実行に移すのです。

ところが現段階のロボット技術では、AI技術以外の問題が浮上します。

現在のロボットは、「サンドイッチを作る」という指示を実行できるほど器用な手を持っていないのです。

柔らかいパンを重ねたり切ったりするのは難しく、トマトをつぶさずに、しかも床に落とさないよう軽く握るのに苦労するのです。

そのためロボットアームの大きな目標の1つは、人間レベルの器用さを身に着けることであり、将来的には人間のように視覚に頼らない繊細な作業を可能にしたいところです。

カンデイト氏ら研究チームは、この分野に取り組み、ロボットアームの器用さを向上させることに成功しました。

これまでに開発されてきた自律的なロボットアームの多くは、触覚以外に視覚を利用していました。

アームと物体をカメラで撮影し、その視覚情報をロボット操作に役立てていたのです。

今回、彼らが開発したロボットアームは、外部カメラを用いずに、アームの触覚フィードバックだけで繊細な扱いができます。